English | 中文

🤗 Hugging Face • 🤖 魔搭 ModelScope • ✡️ 始智 WiseModel

👩🚀 欢迎来 GitHub Discussions 讨论问题

👋 欢迎加入 👾 Discord 或者 💬 微信群 一起交流

📝 欢迎查阅 Yi 技术报告 了解更多

📚 欢迎来 Yi 学习中心 探索新知

[ 返回顶部 ⬆️ ]

## 最新动态Yi-9B-200K 模型。Yi-9B 模型。Yi-9B 模型在 Mistral-7B、SOLAR-10.7B、Gemma-7B、DeepSeek-Coder-7B-Base-v1.5 等相近尺寸的模型中名列前茅,具有出色的代码能力、数学能力、常识推理能力以及阅读理解能力。

Yi-VL-34B 和 Yi-VL-6B 多模态语言大模型。Yi-VL-34B在 MMMU 和 CMMMU 最新的基准测试中荣登榜首(数据截止至 2024 年 1 月)。

Yi-6B-200K 和 Yi-34B-200K Base 模型。 Yi-6B-Base 和 Yi-34B-Base 模型。[ 返回顶部 ⬆️ ]

## 模型 Yi 系列模型有多种参数规模,适用于不同的使用场景。你也可以对Yi模型进行微调,从而满足特定需求。 如需部署 Yi 系列模型,应确保软件和硬件满足「[部署要求](#部署)」. ### Chat 模型 | 模型 | 下载 |---|--- Yi-34B-Chat | • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-34B-Chat) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-34B-Chat/summary) Yi-34B-Chat-4bits | • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-34B-Chat-4bits) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-34B-Chat-4bits/summary) Yi-34B-Chat-8bits | • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-34B-Chat-8bits) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-34B-Chat-8bits/summary) Yi-6B-Chat| • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-6B-Chat) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-6B-Chat/summary) Yi-6B-Chat-4bits | • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-6B-Chat-4bits) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-6B-Chat-4bits/summary) Yi-6B-Chat-8bits | • [🤗 Hugging Face](https://huggingface.co/01-ai/Yi-6B-Chat-8bits) • [🤖 ModelScope](https://www.modelscope.cn/models/01ai/Yi-6B-Chat-8bits/summary) - 4-bits 系列模型由AWQ量化。| Model | Intro | 默认的上下文窗口 | 预训练的 tokens 数量 | 训练数据 |

|---|---|---|---|---|

| 6B 系列模型 | 适合个人和学术使用。 | 4K | 3T | 截至 2023 年 6 月。 |

| 9B 系列模型 | 是 Yi 系列模型中代码和数学能力最强的模型。 | Yi-9B 是在 Yi-6B 的基础上,使用了 0.8T tokens 进行继续训练。 | ||

| 34B 系列模型 | 适合个人、学术和商业用途(尤其对中小型企业友好)。 34B 模型尺寸在开源社区属于稀缺的“黄金比例”尺寸,已具大模型涌现能力,适合发挥于多元场景,满足开源社区的刚性需求。 |

3T |

[ 返回顶部 ⬆️ ]

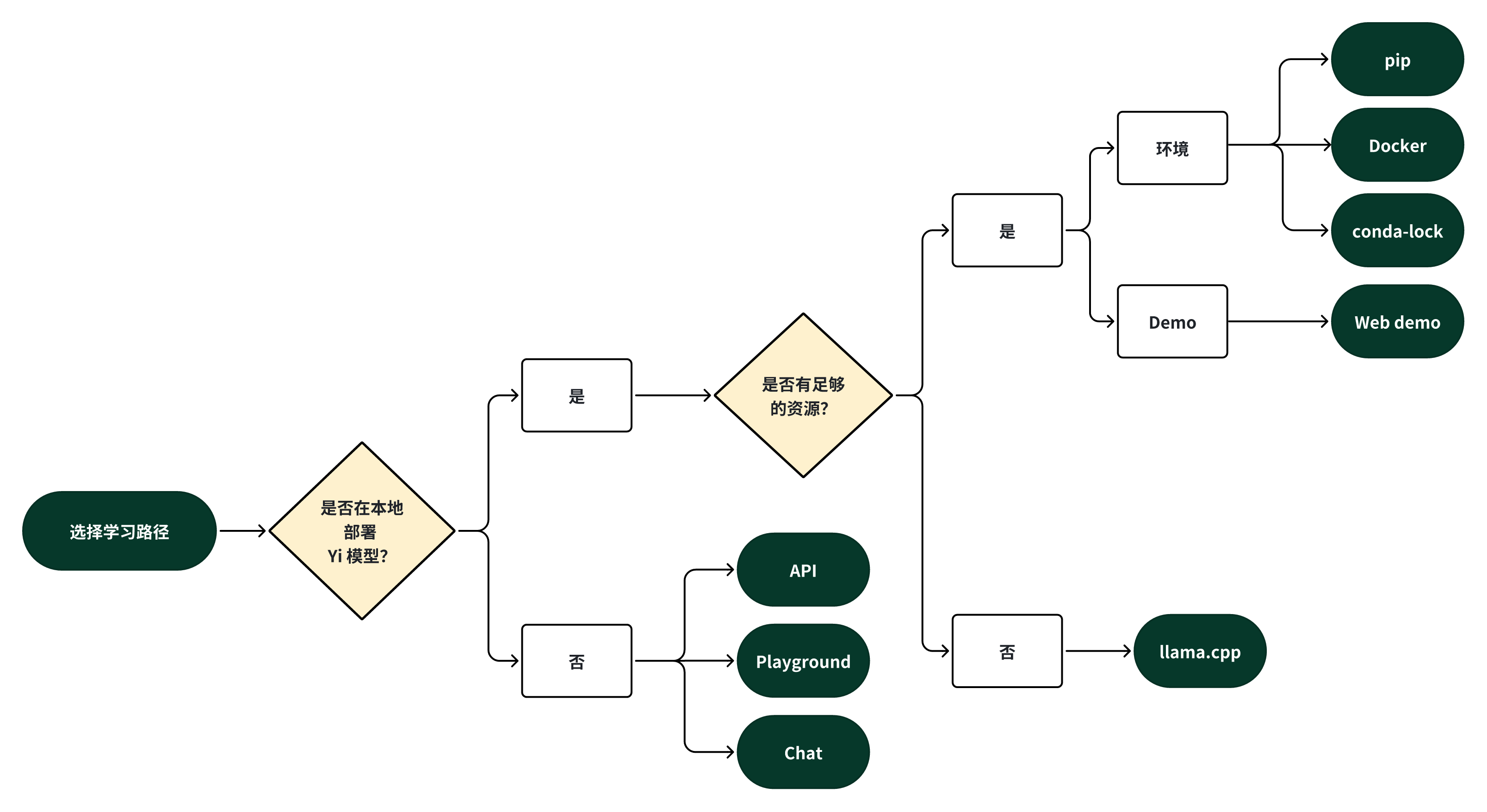

# 📌 如何使用 Yi? - [快速上手](#快速上手) - [选择学习路径](#选择学习路径) - [快速上手 - PyPi (pip install)](#快速上手---pypi-pip-install) - [快速上手 - 使用 Docker](#快速上手---docker) - [快速上手 - 使用 conda-lock](#快速上手---conda-lock) - [快速上手 - 使用 llama.cpp](#快速上手---llamacpp) - [快速上手 - 使用 Web demo](#快速上手---使用-web-demo) - [微调](#微调) - [量化](#量化) - [部署](#部署) - [FAQ](#faq) - [学习中心](#学习中心) ## 快速上手 你可以选择一条学习路径,开始使用 Yi 系列模型。 ### 选择学习路径 你可以根据自身需求,选择以下方式之一,开始你的 Yi 之旅。  #### 🎯 在本地部署 Yi 如果你想在本地部署 Yi 模型, - 🙋♀️ 并且你有**足够**的资源(例如,NVIDIA A800 80GB),你可以选择以下方式之一。 - [pip](#快速上手---pypi-pip-install) - [Docker](#快速上手---docker) - [conda-lock](#快速上手---conda-lock) - 🙋♀️ 但你的资源有限(例如,一台 MacBook Pro),你可以使用 [llama.cpp](#快速上手---llamacpp)。 #### 🎯 不在本地部署 Yi 模型 如果你不想在本地部署 Yi 模型,你可以选择以下方式之一。 ##### 🙋♀️ 使用 Yi API 如果你想探索 Yi 的更多功能,你可以选择以下方式之一。 - Yi APIs (Yi 官方) - [部分申请者](https://x.com/01AI_Yi/status/1735728934560600536?s=20)已获取 Yi API keys。Yi 将开放更多 API keys,敬请期待。 - [Yi APIs](https://replicate.com/01-ai/yi-34b-chat/api?tab=nodejs) (Replicate,第三方网站) ##### 🙋♀️ 使用 Yi Playground 如果你想与 Yi 聊天,并使用更多自定义选项(例如,系统提示、温度、重复惩罚等),你可以选择以下方式之一。 - [Yi-34B-Chat-Playground](https://platform.lingyiwanwu.com/prompt/playground) (Yi 官方) - 如需使用 Yi Playground, 欢迎申请加入白名单(填写[英文](https://cn.mikecrm.com/l91ODJf)或者[中文](https://cn.mikecrm.com/gnEZjiQ)申请表)。 - [Yi-34B-Chat-Playground](https://replicate.com/01-ai/yi-34b-chat) (Replicate,第三方网站) ##### 🙋♀️ 使用 Yi Chat 以下提供了类似的用户体验,你可以选择以下方式之一,与 Yi 聊天。 - [Yi-34B-Chat](https://huggingface.co/spaces/01-ai/Yi-34B-Chat)(Yi 官方 - Hugging Face) - 不需要注册。 - [Yi-34B-Chat](https://platform.lingyiwanwu.com/)(Yi 官方) - 如需使用官方在线聊天服务,欢迎申请加入白名单(填写[英文](https://cn.mikecrm.com/l91ODJf)或[中文](https://cn.mikecrm.com/gnEZjiQ)申请表)。[ 返回顶部 ⬆️ ]

### 快速上手 - PyPi (pip install) 本教程在配置为 **A800(80GB)** 的本地机器上运行 Yi-34B-Chat, 并进行推理。 #### 第 0 步:前提条件 - 确保安装了 Python 3.10 以上版本。 - 如果你想运行 Yi 系列模型,参阅「[部署要求](#部署)」。 #### 第 1 步:准备环境 如需设置环境,安装所需要的软件包,运行下面的命令。 ```bash git clone https://github.com/01-ai/Yi.git cd yi pip install -r requirements.txt ``` #### 第 2 步:下载模型 你可以从以下来源下载 Yi 模型。 - [Hugging Face](https://huggingface.co/01-ai) - [ModelScope](https://www.modelscope.cn/organization/01ai/) - [WiseModel](https://wisemodel.cn/organization/01.AI) #### 第 3 步:进行推理 你可以使用 Yi Chat 模型或 Base 模型进行推理。 ##### 使用 Yi Chat 模型进行推理 1. 创建一个名为 `quick_start.py` 的文件,并将以下内容复制到该文件中。 ```python from transformers import AutoModelForCausalLM, AutoTokenizer model_path = '[ 返回顶部 ⬆️ ]

[ 返回顶部 ⬆️ ]

### 快速上手 - Docker确保你已经安装了 Docker 和 nvidia-container-toolkit。

docker run -it --gpus all \

-v <your-model-path>: /models

ghcr.io/01-ai/yi:latest

或者,你也可以从registry.lingyiwanwu.com/ci/01-ai/yi:latest 拉取已经构建好的 Yi Docker 镜像。

你可以使用 Yi 的 Chat 模型或 Base 模型进行推理。

进行推理的步骤与「 在 pip 上使用 Yi Chat 模型进行推理 」类似。

注意: 唯一不同的是你需要设置 model_path 为 = '<your-model-mount-path>' 而不是 = '<your-model-path>'。

进行推理的步骤与「 在 pip 上使用 Yi Chat 模型进行推理 」类似。

注意: 唯一不同的是你需要设置 model_path 为 = '<your-model-mount-path>' 而不是 = '<your-model-path>'。

conda-lock 工具。 ⬇️micromamba工具来安装这些依赖项。

micromamba install -y -n yi -f conda-lock.yml ,创建一个名为yi conda 环境,并安装所需的依赖项。

[ 返回顶部 ⬆️ ]

### 快速上手 - 使用 Web demo 你可以使用 **Yi Chat 模型**(Yi-34B-Chat)创建 Web demo。 **注意**:Yi Base 模型(Yi-34B)不支持该功能。 [第一步:准备环境](#第-1-步准备环境) [第二步:下载模型](#第-2-步下载模型) 第三步:启动 Web demo 服务,运行以下命令。 ```bash python demo/web_demo.py -c <你的模型路径> ``` 命令运行完毕后,你可以在浏览器中输入控制台提供的网址,来使用 Web demo 功能。 [ 返回顶部 ⬆️ ]

### 微调 ```bash bash finetune/scripts/run_sft_Yi_6b.sh ``` 完成后,你可以使用以下命令,比较微调后的模型与 Base 模型。 ```bash bash finetune/scripts/run_eval.sh ```[ 返回顶部 ⬆️ ]

### 量化 #### GPT-Q 量化 ```bash python quantization/gptq/quant_autogptq.py \ --model /base_model \ --output_dir /quantized_model \ --trust_remote_code ``` 如需评估生成的模型,你可以使用以下代码。 ```bash python quantization/gptq/eval_quantized_model.py \ --model /quantized_model \ --trust_remote_code ```[ 返回顶部 ⬆️ ]

### 部署 如果你想部署 Yi 模型,确保满足以下软件和硬件要求。 #### 软件要求 在使用 Yi 量化模型之前,确保安装以下软件。 | 模型 | 软件 | |:---|:---| Yi 4-bits 量化模型 | [AWQ 和 CUDA](https://github.com/casper-hansen/AutoAWQ?tab=readme-ov-file#install-from-pypi) Yi 8-bits 量化模型 | [GPTQ 和 CUDA](https://github.com/PanQiWei/AutoGPTQ?tab=readme-ov-file#quick-installation) #### 硬件要求 部署 Yi 系列模型之前,确保硬件满足以下要求。 ##### Chat 模型 | 模型 | 最低显存 | 推荐 GPU 示例 | |:----------------------|:--------------|:-------------------------------------:| | Yi-6B-Chat | 15 GB | 1 x RTX 3090 (24 GB)[ 返回顶部 ⬆️ ]

### 下游 > 💡 提示 > > - 如果你开发了与 Yi 相关的服务、模型、工具、平台或其它内容,欢迎提交 PR,将你的成果展示在 [Yi 生态](#下游---服务)。 > > - 为了帮助他人快速理解你的工作,建议使用`<模型名称>: <模型简介> + <模型亮点>`的格式。 #### 下游 - 服务 如果你想在几分钟内开始使用 Yi,你可以使用以下基于 Yi 构建的服务。 - Yi-34B-Chat:你可以通过以下平台与 Yi 聊天。 - [Yi-34B-Chat | Hugging Face](https://huggingface.co/spaces/01-ai/Yi-34B-Chat) - [Yi-34B-Chat | Yi Platform](https://platform.lingyiwanwu.com/) **注意**:如需使用 Yi Platform, 你可以申请加入白名单(填写[英文](https://cn.mikecrm.com/l91ODJf)或[中文](https://cn.mikecrm.com/gnEZjiQ)申请表)。 - [Yi-6B-Chat (Replicate)](https://replicate.com/01-ai):使用该工具,你可以设置自定义参数,调用 APIs 来使用 Yi-6B-Chat。 - [ScaleLLM](https://github.com/vectorch-ai/ScaleLLM#supported-models):你可以使用该工具在本地运行 Yi 模型,根据自身偏好进行个性化设置。 #### 下游 - 量化 如果资源有限,你可以使用 Yi 的量化模型,如下所示。 这些量化模型虽然精度降低,但效率更高,例如,推理速度更快,RAM 使用量更小。 - [TheBloke/Yi-34B-GPTQ](https://huggingface.co/TheBloke/Yi-34B-GPTQ) - [TheBloke/Yi-34B-GGUF](https://huggingface.co/TheBloke/Yi-34B-GGUF) - [TheBloke/Yi-34B-AWQ](https://huggingface.co/TheBloke/Yi-34B-AWQ) #### 下游 - 微调 如果你希望探索 Yi 的其它微调模型,你可以尝试以下方式。 - [TheBloke 模型](https://huggingface.co/TheBloke):该网站提供了大量微调模型,这些微调模型基于多种大语言模型,包括 Yi 模型。 以下是 Yi 的微调模型,根据下载量排序,包括但不限于以下模型。 - [TheBloke/dolphin-2_2-yi-34b-AWQ](https://huggingface.co/TheBloke/dolphin-2_2-yi-34b-AWQ) - [TheBloke/Yi-34B-Chat-AWQ](https://huggingface.co/TheBloke/Yi-34B-Chat-AWQ) - [TheBloke/Yi-34B-Chat-GPTQ](https://huggingface.co/TheBloke/Yi-34B-Chat-GPTQ) - [SUSTech/SUS-Chat-34B](https://huggingface.co/SUSTech/SUS-Chat-34B):该模型在所有 70B 以下的模型中排名第一,超越了体量是其两倍的 deepseek-llm-67b-chat。你可以在 [Open LLM Leaderboard](https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard) 上查看结果。 - [OrionStarAI/OrionStar-Yi-34B-Chat-Llama](https://huggingface.co/OrionStarAI/OrionStar-Yi-34B-Chat-Llama):该模型在 C-Eval 和 CMMLU 评估中超越了其它模型(例如,GPT-4、Qwen-14B-Chat 和 Baichuan2-13B-Chat),在 [OpenCompass LLM Leaderboard](https://opencompass.org.cn/leaderboard-llm) 上表现出色。 - [NousResearch/Nous-Capybara-34B](https://huggingface.co/NousResearch/Nous-Capybara-34B):该模型在 Capybara 数据集上使用 200K 上下文长度和 3 个 epochs 进行训练。 #### 下游 - API - [amazing-openai-api](https://github.com/soulteary/amazing-openai-api):此工具可以将 Yi 模型 API 转换成 OpenAI API 格式。 - [LlamaEdge](https://www.secondstate.io/articles/yi-34b/#create-an-openai-compatible-api-service-for-the-yi-34b-chat-model):你可以通过该工具快速部署 Yi-34B-Chat 并开始聊天。该工具由 Rust 语言开发,使用可移植的 Wasm(WebAssembly)文件构建了一个与 OpenAI 兼容的 API 服务器。[ 返回顶部 ⬆️ ]

## 基准测试 - [Chat 模型性能](#chat-模型性能) - [Base 模型性能](#base-模型性能) ### Chat 模型性能 Yi-34B-Chat 模型表现出色,在 MMLU、CMMLU、BBH、GSM8k 等所有开源模型的基准测试中排名第一。[ 返回顶部 ⬆️ ]

## 技术报告 更多关于 Yi 系列模型性能的详细信息,参阅 「[Yi:Open Foundation Models by 01.AI](https://arxiv.org/abs/2403.04652)」。 ### 引用 ``` @misc{ai2024yi, title={Yi: Open Foundation Models by 01.AI}, author={01. AI and : and Alex Young and Bei Chen and Chao Li and Chengen Huang and Ge Zhang and Guanwei Zhang and Heng Li and Jiangcheng Zhu and Jianqun Chen and Jing Chang and Kaidong Yu and Peng Liu and Qiang Liu and Shawn Yue and Senbin Yang and Shiming Yang and Tao Yu and Wen Xie and Wenhao Huang and Xiaohui Hu and Xiaoyi Ren and Xinyao Niu and Pengcheng Nie and Yuchi Xu and Yudong Liu and Yue Wang and Yuxuan Cai and Zhenyu Gu and Zhiyuan Liu and Zonghong Dai}, year={2024}, eprint={2403.04652}, archivePrefix={arXiv}, primaryClass={cs.CL} } ``` # 📌 谁可以使用 Yi? 答案是所有人! 🙌 ✅ 关于如何使用 Yi 系列模型,参阅「[许可证](#许可证)」。[ 返回顶部 ⬆️ ]

# 📌 其它 ### 致谢 我们对每位火炬手都深表感激,感谢你们为 Yi 社区所做的贡献。因为有你们,Yi 不仅是一个项目,还成为了一个充满活力的创新社区。我们由衷地感谢各位小伙伴! [](https://github.com/01-ai/yi/graphs/contributors) #### 本文贡献者 Yi Readme 中文版由以下[贡献者](https://github.com/01-ai/Yi/wiki/%F0%9F%93%9A-Yi-Translation-Plan#contributor-list)完成,排名不分先后,以用户名首字母顺序排列。 - Prompt 专家:[@kevinhall1998](https://github.com/kevinhall1998) - 译员:[@202030481266](https://github.com/202030481266)、[@GloriaLee01](https://github.com/GloriaLee01)、[@markli404](https://github.com/markli404)、[@petter529](https://github.com/petter529) 与 [@soulteary](https://github.com/soulteary) - 审校:[@Anonymitaet](https://github.com/Anonymitaet)、[@bltcn](https://github.com/bltcn)、[@Cookize](https://github.com/Cookize)、[@lljzhgxd](https://github.com/lljzhgxd) 与 [@markli404](https://github.com/markli404)[ 返回顶部 ⬆️ ]

### 免责声明 在训练过程中,我们使用数据合规性检查算法,最大程度地确保训练模型的合规性。由于数据复杂且语言模型使用场景多样,我们无法保证模型在所有场景下均能生成正确合理的回复。注意,模型仍可能生成有误的回复。对于任何因误用、误导、非法使用、错误使用导致的风险和问题,以及与之相关的数据安全问题,我们均不承担责任。[ 返回顶部 ⬆️ ]

### 许可证 本仓库中的源代码遵循 [Apache 2.0 许可证](https://github.com/01-ai/Yi/blob/main/LICENSE)。Yi 系列模型完全开放,你可以免费用于个人用途、学术研究和商业用途。如需商用,你仅需[提交申请](https://www.lingyiwanwu.com/yi-license),即能立刻自动获取 Yi 系列模型商用许可,而无需等待官方审批。所有使用必须遵守[《Yi系列模型社区许可协议 2.1》](https://github.com/01-ai/Yi/blob/main/MODEL_LICENSE_AGREEMENT.txt)。[ 返回顶部 ⬆️ ]